传统并行计算:共享同一个数据,通过锁来控制数据的读写,难度大,容易导致死锁,拓展性差。但是是实时的,细颗粒度计算,计算密集型

Mapreduce:对机器的要求低,拓展性难,便宜,拓展性强,批处理场景,非实时,数据密集型(傻大)

map:分配工作任务给不同的人,并让其完成工作(工作相互独立,不互相为上下环节)

reduce:把不同的结果集合并 再加上分布式

1.如小写字母变成大写字母 map

2.把年龄小于16岁的都去掉 map

3.把美元变成人民币 y=x∗6.3y=x * 6.3y=x∗6.3 map

4.地址库的一个翻译:省市县 map

5.(只要是一些处理数据相关的,都应当是在map上)

1.统计年薪最高的人 (一个组)key

2.按照男女计算平均年龄 (俩个组)key

3.排序 reduce

a-------->a----->A

map--------- reduce ×

前提:尽量要减少数据的流动,reduce阶段数据越少越好,能在map做就在map做掉

Select name ,age,gender from people where id =3

Select name ,age,gender

id=3

如:Select avg(age),gender from peoplemap:age,gender ---project

key:gender(F,M) //分为man和femalereduce:按照key进行汇集 F(25,38,23),M(45,23)

reduce:avg

如:Select max(age),gender from people这里和上面差不多,但是就没有key了放在同一个地方

在文件系统上

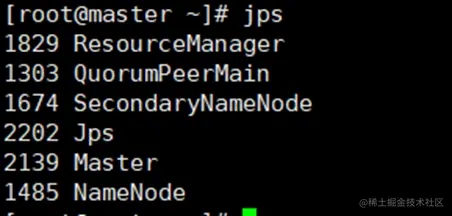

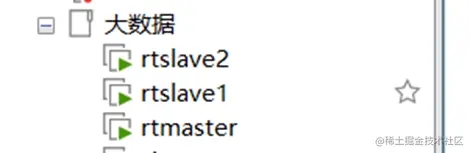

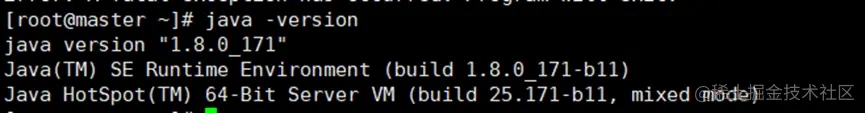

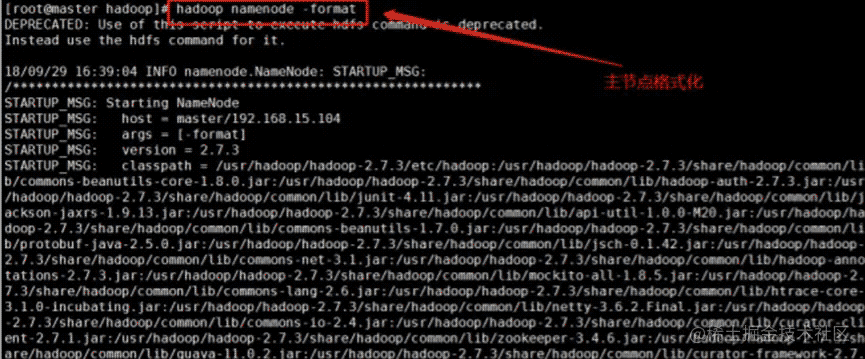

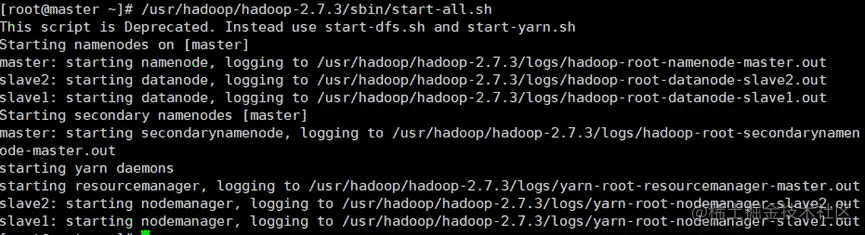

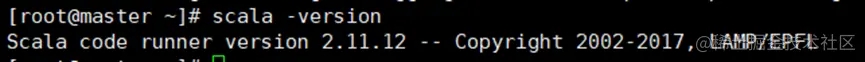

为了模拟真实情况,我这里搭建了分布式的hadoop集群,分别有三台机器。一台做master,一台做slave。

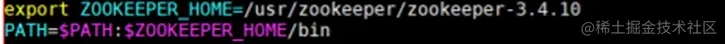

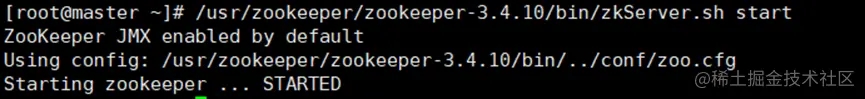

/usr/zookeeper/zookeeper-3.4.10/bin/zkServer.sh start

/usr/hadoop/hadoop-2.7.3/sbin/start-all.sh

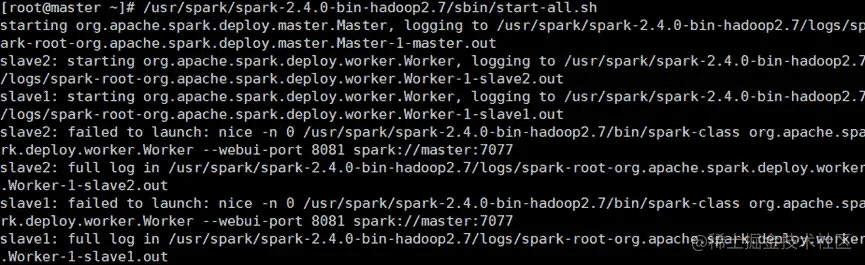

/usr/spark/spark-2.4.0-bin-hadoop2.7/sbin/start-all.sh